Der KI beibringen, Ihr Haustier zu erkennen: Neue MIT-Methode trainiert Modelle, um personalisierte Objekte zu erkennen

Stellen Sie sich Folgendes vor: Ihre bezaubernde französische Bulldogge Bowser ist im örtlichen Hundepark. Im Gewirr der herumtollenden Hunde können Sie Bowser leicht erkennen. Aber was wäre, wenn Sie sich eine KI wünschen würden, die dasselbe tut, während Sie sich im Büro verkriechen? An diesem Punkt werden die Dinge kompliziert.

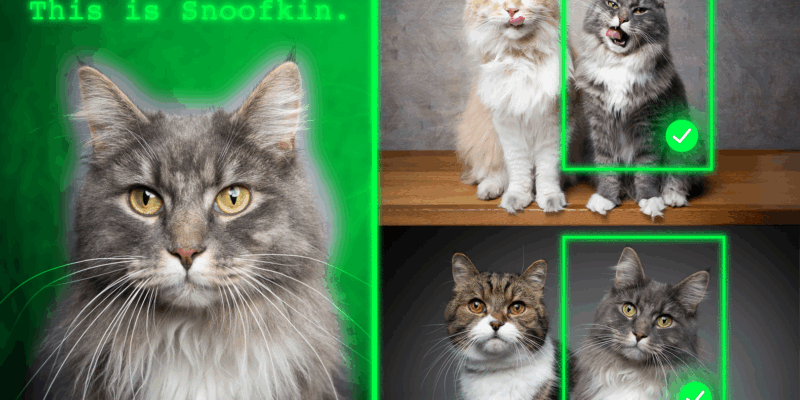

Unsere derzeitigen Vision-Language-Modelle (VLMs), wie das beliebte GPT-5, sind hervorragend in der Lage, allgemeine Objekte zu erkennen. So ist es zum Beispiel ein Kinderspiel, einen ‘Hund’ oder einen ‘Baum’ zu erkennen. Die Herausforderung entsteht jedoch, wenn diese Modelle ein spezifisches, personalisiertes Objekt erkennen sollen. Wenn man von einer KI erwartet, dass sie Bowser, den Frenchie, in einer Reihe französischer Bulldoggen erkennt, würde sie wahrscheinlich straucheln. Dies ist ein Hindernis für jeden, der KI für Aufgaben wie die Überwachung von Haustieren, die Verfolgung von Objekten oder assistive Technologien einsetzen möchte.

Das Streben nach Personalisierung

Um diese Lücke zu schließen, haben Forscher des MIT und des MIT-IBM Watson AI Lab eine neue Trainingsmethode entwickelt, die es KI-Modellen ermöglicht, personalisierte Objekte in verschiedenen Szenen besser zu erkennen. Sie arbeiteten daran, VLMs mit speziell kuratierten Video-Tracking-Daten neu zu trainieren, die dasselbe Objekt über eine Reihe von Bildern verfolgen. Diese Methode zwingt das Modell im Wesentlichen dazu, sich auf kontextbezogene Hinweise zu verlassen, anstatt auf gespeicherte Informationen. Das KI-Modell wird mit einer Handvoll Beispielbildern eines bestimmten Objekts gefüttert, z. B. einem Haustier oder einem Rucksack. Das überarbeitete System ist dann wesentlich besser in der Lage, dieses Objekt in neuen Bildern zu erkennen, wobei die allgemeinen Fähigkeiten des Modells erhalten bleiben.

Es zum Leben erwecken

Dieser Fortschritt könnte sich in verschiedenen Bereichen als bahnbrechend erweisen. Von KI-Systemen, die bestimmte Tiere für Umweltstudien aufspüren, bis hin zu Hilfstechnologien, die sehbehinderten Nutzern helfen, persönliche Gegenstände in ihren Häusern zu finden - die Möglichkeiten sind vielfältig. Diese Technik könnte auch die Robotik und Augmented-Reality-Tools verstärken, die eine schnelle und genaue Identifizierung bestimmter Objekte in einer sich entwickelnden Umgebung erfordern.

Das Projekt wird von Jehanzeb Mirza geleitet, einem MIT-Postdoktoranden und Hauptautor der Forschungsarbeit. Neben Mirza hat auch ein Team von Forschern des MIT, des Weizmann Institute of Science und von IBM eine entscheidende Rolle bei dem Projekt gespielt. Ihre Ergebnisse werden auf der kommenden International Conference on Computer Vision vorgestellt.

Den menschlichen Geist nachahmen

Mirza zufolge besteht das ultimative Ziel für diese Modelle darin, “aus dem Kontext zu lernen, so wie es Menschen tun”. Wenn ein KI-Modell dies erreichen kann, müsste es nicht für jede neue Aufgabe neu trainiert werden, sondern könnte mit einigen Beispielen gefüttert werden und würde aus diesem Kontext ableiten, wie die Aufgabe auszuführen ist. Dies wäre seiner Meinung nach eine unübertroffene Fähigkeit. Diese Vision ist jedoch nicht ohne eine Reihe von Herausforderungen. Die Forschungsgemeinschaft muss noch eine endgültige Antwort auf die Frage finden, warum VLMs Schwierigkeiten haben, wo Menschen sie nicht haben. Das Problem könnte in der Integration der visuellen und sprachlichen Komponenten liegen, bei der einige visuelle Informationen verloren gehen, aber die Schlussfolgerung ist noch nicht eindeutig.

Die Arbeit des Teams hat zu beeindruckenden Fortschritten geführt. Mit ihrem neu kuratierten Datensatz beobachteten sie eine durchschnittliche Verbesserung von 12% bei der personalisierten Objektlokalisierung. Bei Verwendung von Pseudonamen anstelle der tatsächlichen Objektnamen stieg die Leistung sogar um bis zu 21%. Je größer das Modell ist, desto größer ist auch der Leistungszuwachs. Für die Zukunft plant das Team, die Unstimmigkeiten beim Lernen von VLMs und LLMs genauer zu untersuchen und neue Strategien zu erforschen, um die VLM-Leistung zu verbessern, ohne die Modelle ständig neu trainieren zu müssen.

Mirza und sein Team haben das enorme Potenzial für eine schnelle, instanzspezifische Einbindung in praktische Arbeitsabläufe erkannt und sind überzeugt, dass ihr datenzentrierter Ansatz die weit verbreitete Integration von Modellen für die Grundlage der Bildsprache unterstützen kann. Gemeinsam mit Mirza haben Wei Lin, Eli Schwartz, Hilde Kuehne, Raja Giryes, Rogerio Feris, Leonid Karlinsky, Assaf Arbelle und Shimon Ullman an dieser bahnbrechenden Arbeit gearbeitet, die vom MIT-IBM Watson AI Lab finanziert wurde.

Weitere Einzelheiten finden Sie in dem Originalartikel hier.