Entfaltung des vollen Potenzials von Sprachmodellen: Alle Ebenen für mehr Genauigkeit nutzen

Ein neuer Ansatz für die Verwendung von Sprachmodellen

Das digitale Zeitalter hat die Art und Weise, wie wir mit Technologie umgehen, grundlegend verändert. Große Sprachmodelle (Large Language Models, LLMs) wie GPT und BERT, die von leistungsstarken tiefen neuronalen Netzen unterstützt werden, stehen an der Spitze dieser digitalen Entwicklung. Sie haben alles revolutioniert, von der Verfeinerung von Suchmaschinenergebnissen bis hin zu ausgefeilten Chatbots. Könnte es aber sein, dass wir diese Modelle unter Wert verkaufen, weil wir sie nicht optimal nutzen? Werfen wir einen genaueren Blick auf eine aufregende neue Perspektive, die in der Welt der LLMs für Aufsehen sorgt.

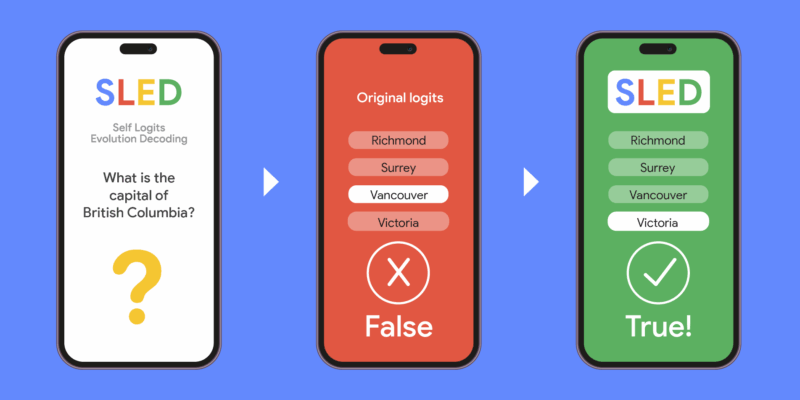

Üblicherweise verlassen sich diese LLMs auf die letzte Schicht der neuronalen Netze, um ihre Endausgabe zu liefern. Man geht davon aus, dass diese oberste Schicht den Zenit des Verständnisspektrums des Modells darstellt. Doch die bahnbrechenden Forscher von Google stellen diese Vorstellung in Frage. Sie vermuten, dass auch in den früheren Schichten des Netzwerks ein wahrer Schatz an Erkenntnissen vorhanden ist, der oft ungenutzt bleibt. Diese faszinierende Enthüllung deutet auf die Möglichkeit hin, nicht nur die letzte Schicht, sondern auch alle davor liegenden glänzenden Schichten für reichhaltigere, nuanciertere Ergebnisse zu nutzen.

Enthüllung der Layer-Aggregation: Ein Spielveränderer

Die bahnbrechende Technik von Google, die so genannte "Layer Aggregation", fördert die Nutzung des gesamten Schichtenspektrums. Es greift Informationen aus jeder Ebene auf und bildet eine umfassende Verschmelzung. Bei diesem Ansatz handelt es sich nicht um eine bloße Ansammlung von Elementen, sondern um eine harmonische Mischung, die die einzigartigen Fähigkeiten jeder Ebene bei der Erfassung verschiedener Sprachaspekte - sei es Syntax, Semantik oder Kontext - einbezieht und so einen angereicherten Funktionssatz fördert.

Leistungsmetriken umschreiben und Effizienz neu definieren

Die Auswirkungen dieser integrativen Technik sind nicht nur theoretisch, sondern haben auch messbare Vorteile. Experimente zeigen eine bemerkenswerte Leistungsverbesserung bei mehreren natürlichsprachlichen Aufgaben, die mit Layer Aggregation durchgeführt werden. Ob bei der Beantwortung von Fragen, bei der Zusammenfassung oder bei der Übersetzung - dieser mehrschichtige Ansatz übertrumpft eigenständige Schichtstrategien.

Aber es gibt noch mehr. Würde das Modell durch das Hinzufügen von Schichten nicht nur überladen? Ganz und gar nicht! Im Gegensatz zu dieser intuitiven Annahme kann die Technik der Ebenenaggregation effizient implementiert werden und erfordert oft nur wenig oder gar keine zusätzlichen Berechnungen. Im Grunde genommen erhalten Sie ein intelligenteres, schnelleres Sprachmodell, ohne Kompromisse bei der Effizienz eingehen zu müssen.

Auf breiterer Ebene läutet diese Forschung eine neue Ära der Möglichkeiten ein, noch versiertere Sprachsysteme zu entwickeln. Durch eine Neukalibrierung der Art und Weise, wie wir unsere bestehende digitale Architektur nutzen, können Entwickler und Forscher eine neue Generation von Werkzeugen schaffen, die ihre Vorgänger sowohl an Genauigkeit als auch an Effizienz übertreffen. Möchten Sie tiefer in diese bahnbrechende Errungenschaft eintauchen? Sehen Sie sich den Originalartikel von Google Research an: Genauere LLMs durch Nutzung aller ihrer Schichten.