Robotern das Verstehen ihres Körpers beibringen - nur mit einer Kamera

Forscher des Computer Science and Artificial Intelligence Laboratory (CSAIL) des MIT haben eine revolutionäre Methode zur Steuerung von Robotern entwickelt, die sich am menschlichen adaptiven Lernen orientiert. Im Gegensatz zu herkömmlichen Robotersystemen, die mit einer Reihe komplexer Sensoren und sorgfältig von Hand erstellten Bewegungsmodellen ausgestattet sind, kann dieses neue System mit der Bezeichnung "Neural Jacobian Fields" (NJF) Roboter dazu anleiten, ihre eigenen Körperbewegungen und Reaktionen auf Befehle allein durch Beobachtung selbst zu erlernen.

Im Herzen des CSAIL-Labors ergreift eine weiche Roboterhand flink und geschickt einen winzigen Gegenstand. Bemerkenswert ist, dass die Hand sensorlos ist und ihre Bewegungen, die von einer einzigen Kamera beobachtet werden, allein durch visuelle Daten gesteuert werden. Diese bahnbrechende Technologie folgt nicht dem starren Programmieransatz, der bisher die Norm war. Stattdessen begibt sie sich in den Bereich des Lehrens und Lernens. Die Roboter werden zu Schülern - sie beobachten, lernen und passen ihre Bewegungen an, genau wie Menschen.

"Diese Arbeit deutet auf eine Verlagerung von der Programmierung von Robotern zum Unterrichten von Robotern hin", sagt Sizhe Lester Li, der MIT-Doktorand, der die Forschung leitete. "Anstatt jede Bewegung zu kodieren, können wir einem Roboter eine Aufgabe zeigen und ihn herausfinden lassen, wie er sie zu bewältigen hat.

Diese Innovation stellt das traditionelle Modell völlig auf den Kopf, das auf ein starres Design und eine mit Sensoren ausgestattete Technologie setzt, um die Kontrolle zu gewährleisten. NJF ermöglicht eine noch nie dagewesene Freiheit, die es Robotern (unabhängig davon, ob sie weich, unregelmäßig oder ohne Sensoren sind) ermöglicht, ihr eigenes internes Bewegungsverständnis aufzubauen, indem sie einfach beobachten und sich anpassen. Dieser radikale Ansatz eröffnet Ingenieuren unendliche Möglichkeiten, bioinspirierte Maschinen zu entwickeln, ohne sich um spätere Kontroll- oder Modellierungskomplikationen kümmern zu müssen.

"Das ist so, als würde man lernen, seine Gliedmaßen zu kontrollieren. Man beobachtet, wackelt und passt sich an", erklärt Li. "Das ist das gleiche Prinzip, das unser System anwendet."

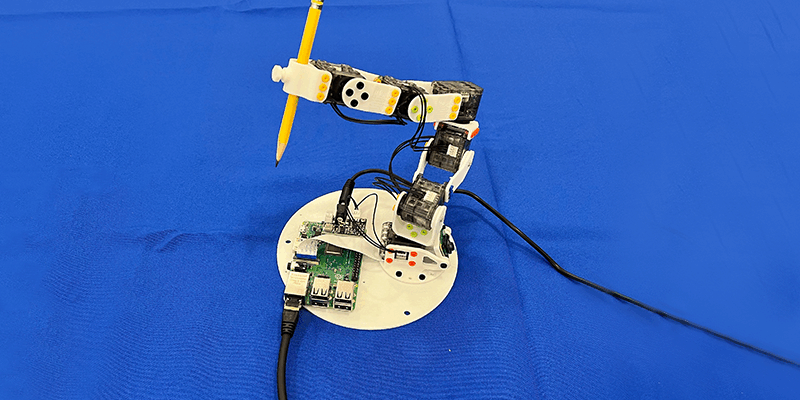

Das Team testete NJF an verschiedenen Roboterformen - von einer pneumatischen Soft-Hand über eine starre Allegro-Hand bis hin zu einem 3D-gedruckten Arm und einer rotierenden Plattform ohne Sensoren. In jedem Fall verwendete das System visuelle und zufällige Bewegungsdaten, um die Geometrie des Roboters und seine Reaktion auf Befehle zu lernen und zu verstehen. Nach dem Training benötigt der Roboter nur eine einzige monokulare Kamera, um in Echtzeit zu agieren, und erreicht dabei eine Geschwindigkeit von 12 Bildern pro Sekunde - ein bedeutender Fortschritt im Vergleich zu anderen Simulatoren.

In NJF ist ein neuronales Netz eingebettet, das zwei wichtige Aspekte erlernt: die 3D-Form des Roboters und seine Reaktion auf Steuersignale. Das System lernt, indem es zufällige Aktionen des Roboters beobachtet, ohne dass menschliche Eingaben oder bereits vorhandenes Wissen erforderlich sind.

"Das Sehvermögen allein kann die für die Lokalisierung und Steuerung erforderlichen Hinweise liefern", sagt Daniela Rus, Direktorin des CSAIL und Mitautorin der Studie. "Dies öffnet die Tür zu Robotern, die in chaotischen, unstrukturierten Umgebungen funktionieren können - ohne kostspielige Infrastruktur."

Zu den derzeitigen Herausforderungen gehören die Notwendigkeit, jeden Roboter einzeln mit mehreren Kameras zu trainieren, und das Fehlen eines Tastsinns. Mit Unterstützung des Solomon Buchsbaum Research Fund, des MIT Presidential Fellowship, der National Science Foundation und des Gwangju Institute of Science and Technology ist das Team jedoch bestrebt, das Potenzial des Systems durch die Bewältigung dieser Herausforderungen zu verbessern.

"Ähnlich wie der Mensch ein intuitives Gefühl für die Bewegungen seines Körpers entwickelt", sagt Li. "NJF vermittelt Robotern diese Art von verkörpertem Verständnis und legt damit den Grundstein für eine flexible, adaptive Steuerung in der realen Welt."

Ausführlichere Informationen über diese Forschung finden Sie auf MIT News: https://news.mit.edu/2025/vision-based-system-teaches-machines-understand-their-bodies-0724