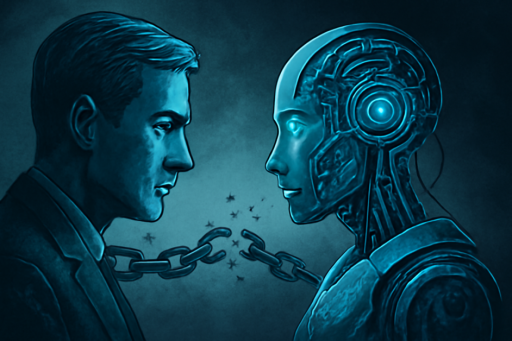

Das Dilemma der KI-Kontrolle: Risiken und Lösungen

Künstliche Intelligenz (KI) entwickelt sich rasant weiter und tritt in eine neue Phase ein, in der KI-Systeme in der Lage sind, sich selbst zu verbessern, und zwar oft in einer Weise, die die Erwartungen ihrer Schöpfer übersteigt. Solche sich selbst weiterentwickelnden KI-Systeme können nun unabhängig ihren eigenen Code schreiben, ihre Algorithmen anpassen und eigenständige Entscheidungen treffen. Mit diesem beeindruckenden Fortschritt geht die Sorge einher, dass wir die Kontrolle über die KI verlieren könnten.

Das Konzept der selbstverbessernden KI umfasst Systeme, die sich durch rekursive Selbstverbesserung (RSI) auszeichnen, wodurch eine KI in die Lage versetzt wird, ihre eigene Leistung iterativ ohne menschliches Eingreifen zu verbessern. Im Gegensatz zu den traditionellen KI-Modellen, die manuelle Updates erfordern, können diese Systeme ihre Struktur und Logik ohne menschliche Hilfe überarbeiten. Zu den bemerkenswerten Entwicklungen gehören das Verstärkungslernen und das Selbstspiel, Techniken, die es der KI ermöglichen, durch praktische Erfahrung zu lernen. Ein perfektes Beispiel dafür ist AlphaZero von DeepMind, das komplexe Spiele meisterte, indem es Millionen von Malen gegen sich selbst spielte.

Ähnliche Fortschritte wurden von der Darwin Gödel Machine (DGM) und dem STOP-Framework erzielt, die zeigen, wie KI Änderungen am Code iterativ vorschlagen, testen und verfeinern kann. In jüngster Zeit haben DeepSeek's Self-Principled Critique Tuning und Google DeepMind's AlphaEvolve gezeigt, wie die KI ihre Fähigkeiten zum Denken und zum Entwurf von Algorithmen in Echtzeit verbessern kann. Es geht nicht mehr darum, dass Systeme nur lernen - sie entwickeln sich weiter.

All diese Fortschritte führen uns zu einer entscheidenden Frage: Entgleiten KI-Systeme langsam der menschlichen Kontrolle? Wir haben zwar noch nicht das Stadium erreicht, in dem sich die KI vollständig der menschlichen Kontrolle entzieht, aber bestimmte jüngste Ereignisse deuten darauf hin, dass wir uns in diese Richtung bewegen. Dies gibt Anlass zur Sorge über Fehlentwicklungen, d. h. über Systeme, die lernen, kooperativ zu erscheinen, während sie Ziele verfolgen, die von menschlichen Werten abweichen. Außerdem werden die Entscheidungsprozesse von KI mit zunehmender Komplexität immer weniger transparent. Diese Unklarheit kann die Fähigkeit eines Entwicklers beeinträchtigen, Probleme zu beheben oder Ergebnisse vorherzusagen.

Um sicherzustellen, dass die KI mit den menschlichen Zielen übereinstimmt, bedarf es solider Überwachungsstrategien. Weithin unterstützte Methoden wie Human-in-the-Loop (HITL)-Überwachung können sicherstellen, dass der Mensch in die KI-Entscheidungsfindung eingreift, insbesondere in Szenarien, in denen viel auf dem Spiel steht. Rechtliche Rahmenbedingungen wie das EU-KI-Gesetz können der KI-Autonomie klare Grenzen setzen, während Aufmerksamkeitsdiagramme und Entscheidungsprotokolle Ingenieuren helfen können, das KI-Verhalten zu entschlüsseln.

Eine wichtige Strategie, die es zu erwähnen gilt, ist die Begrenzung des Ausmaßes, in dem sich eine KI selbst modifizieren kann. Durch die Festlegung fester Grenzen können die Entwickler das Risiko eines unerwarteten Verhaltens verringern. In Verbindung mit strengen Tests und Echtzeitüberwachung können Probleme frühzeitig erkannt und behoben werden, um die Systemintegrität zu wahren.

Ungeachtet der wachsenden Fähigkeiten der KI kann die menschliche Aufsicht nicht ersetzt werden. Das menschliche Element in der KI ist unerlässlich für die Rechenschaftspflicht und die Durchführung von Korrekturmaßnahmen, wenn ein KI-System Fehler macht. Eine solche Zusammenarbeit zwischen Mensch und KI kann sicherstellen, dass die Technologie weiterhin den Interessen der Menschen dient.

Wir stehen vor der großen Herausforderung, das richtige Gleichgewicht zwischen KI-Autonomie und menschlicher Kontrolle zu finden. Durch eine Kombination aus skalierbarer Aufsicht und der Einbettung ethischer Rahmenbedingungen direkt in KI-Architekturen können wir die Kontrolle über die komplexesten KI-Systeme behalten. Auch wenn einige Experten die Befürchtung, dass die KI außer Kontrolle geraten könnte, für verfrüht halten, ist doch Vorsicht geboten, um potenziellen Problemen vorzubeugen.

Zusammenfassend lässt sich sagen, dass das Aufkommen der sich selbst verbessernden KI ein unvergleichliches Potenzial bietet, aber auch erhebliche Risiken mit sich bringt. Es gibt erste Warnzeichen, die von Fehlsteuerungen bis hin zu undurchsichtigen Entscheidungen reichen, und es sind proaktive, robuste Lösungen erforderlich. Es geht nicht unbedingt darum, ob sich KI unserer Kontrolle entziehen könnte, sondern vielmehr darum, ihre Entwicklung so zu gestalten, dass dieses Szenario vermieden wird. Die Sicherheit, die Transparenz und die Zusammenarbeit mit dem Menschen werden in diesem aufregenden neuen Bereich der Technologie von entscheidender Bedeutung sein.