Uwolnienie pełnego potencjału modeli językowych: Wykorzystanie wszystkich warstw dla większej dokładności

Świeże spojrzenie na wykorzystanie modeli językowych

Era cyfrowa zapoczątkowała morze transformacji w sposobie, w jaki angażujemy się w technologię. Duże modele językowe (LLM), takie jak GPT i BERT, obsługiwane przez potężne głębokie sieci neuronowe, stoją na czele tej cyfrowej ewolucji. Zrewolucjonizowały one wszystko, od udoskonalania wyników wyszukiwarek po zaawansowane chatboty. Ale czy nie sprzedajemy tych modeli za mało, nie wykorzystując ich optymalnie? Przyjrzyjmy się bliżej nowej, ekscytującej perspektywie, która wywołuje spore poruszenie w świecie LLM.

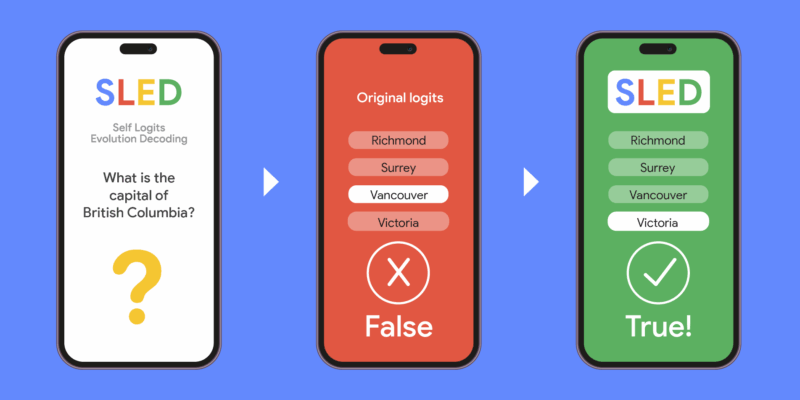

Zazwyczaj te LLM polegają na ostatniej warstwie sieci neuronowych, aby dostarczyć swoje końcowe wyniki. Uważa się, że ta najwyższa warstwa reprezentuje zenit spektrum rozumienia modelu. Jednak pionierscy badacze z Google podważają to przekonanie. Sugerują oni, że prawdziwa skarbnica spostrzeżeń, często niewykorzystana, istnieje również we wcześniejszych warstwach sieci. To intrygujące odkrycie wskazuje na możliwość wykorzystania nie tylko ostatniej warstwy, ale wszystkich błyszczących warstw prowadzących do niej w celu uzyskania bogatszych, bardziej zniuansowanych wyników.

Ujawnienie agregacji warstw: Zmiana zasad gry

Przełomowa technika Google, nazwana "Layer Aggregation", zachęca do zbierania całego potencjału spektrum warstw. Pobiera informacje z każdej warstwy, tworząc kompleksowe połączenie. Podejście to nie jest jedynie zbiorem elementów; jest to harmonijna mieszanka, która zawiera unikalne możliwości każdej warstwy w przechwytywaniu różnych aspektów językowych - czy to składni, semantyki czy kontekstu, wspierając w ten sposób wzbogacony zestaw funkcji.

Przepisywanie wskaźników wydajności i redefiniowanie wydajności

Wpływ tej integracyjnej techniki nie jest tylko teoretyczny - przynosi ona wymierne korzyści. Eksperymenty wykazały znaczną poprawę wydajności w wielu zadaniach języka naturalnego przy użyciu agregacji warstw. Niezależnie od tego, czy chodzi o odpowiadanie na pytania, podsumowywanie czy tłumaczenie - to warstwowe podejście przewyższa samodzielne strategie warstw.

Ale to nie wszystko. Czy dodawanie warstw nie spowodowałoby tylko spowolnienia modelu? Wcale nie! W przeciwieństwie do tego intuicyjnego założenia, technika agregacji warstw może być efektywnie zaimplementowana, często wymagając niewielkich lub żadnych dodatkowych obliczeń. Zasadniczo otrzymujemy inteligentniejszy, szybszy model językowy bez konieczności rezygnacji z wydajności.

W szerszej skali, badania te zwiastują nową erę możliwości w konstruowaniu jeszcze bardziej inteligentnych systemów językowych. Poprzez ponowną kalibrację sposobu, w jaki wykorzystujemy naszą istniejącą architekturę cyfrową, programiści i badacze mogą stworzyć nową generację narzędzi, które przewyższają swoich poprzedników zarówno pod względem dokładności, jak i wydajności. Chcesz zagłębić się w to przełomowe osiągnięcie? Zapoznaj się z oryginalnym artykułem Google Research: Zwiększanie dokładności LLM poprzez wykorzystanie wszystkich ich warstw.