Jak generatywna sztuczna inteligencja rewolucjonizuje szkolenie robotów dzięki realistycznym wirtualnym światom

Chatboty, takie jak ChatGPT i Claude, wplotły się w tkankę naszego cyfrowego życia dzięki swojej niesamowitej wszechstronności, zdolnej do wykonywania zadań od debugowania kodu po tworzenie poezji. Swoją finezję zawdzięczają ogromnej ilości danych tekstowych zebranych z Internetu, na których są szkolone. Jednak szkolenie robotów działających w środowisku fizycznym wymaga znacznie więcej niż tylko danych tekstowych. Te roboty rozwijają się w kontekście wizualnym i fizycznym, umożliwiając im płynną interakcję z otoczeniem - niezależnie od tego, czy chodzi o umieszczenie filiżanki kawy na stole, czy układanie naczyń bez powodowania stukotu. Nauczenie się tych operacji to nie lada wyczyn - wymaga demonstracji przypominających poradniki dla każdego zadania. Problem? Gromadzenie tych rzeczywistych demonstracji jest nie tylko pracochłonne, ale może być również niespójne i kosztowne.

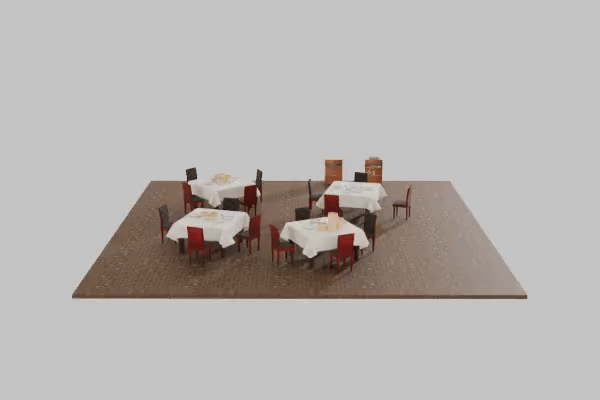

W tym miejscu wkraczają przełomowe prace Laboratorium Nauk Komputerowych i Sztucznej Inteligencji MIT (CSAIL) oraz Toyota Research Institute. Badacze ci opracowali zmieniającą paradygmat metodę nazwaną Sterowane generowanie scenW tym celu opracowano metodę tworzenia wirtualnych środowisk 3D - na przykład kuchni lub restauracji - zdolnych do symulowania wielu zadań wykonywanych przez roboty. Metoda ta opiera się na modelu dyfuzyjnym, poddziedzinie sztucznej inteligencji, która zaczyna się od losowego szumu i stopniowo przekształca go w ustrukturyzowany obraz. Model ten jest zgodny z prawami fizyki, tworząc wiarygodne sceny i obiekty. Na przykład zapewnia, że widelec nie będzie unosił się w misce z zupą, dodając odrobinę realizmu.

Cechą wyróżniającą tę metodę jest integracja Monte Carlo Tree Search (MCTS) - strategii inspirowanej systemami gier AI, takimi jak AlphaGo. MCTS zapewnia modelowi obiektyw do badania wielu potencjalnych sposobów konstruowania sceny, wybierając najbardziej realistyczną lub wartościową wersję w oparciu o cel. Niezależnie od tego, czy chodzi o maksymalizację różnorodności produktów spożywczych przechowywanych w kuchni, czy o coś innego - MCTS sprosta temu zadaniu. Nicholas Pfaff, doktorant na MIT EECS, który stoi na czele projektu, wyjaśnia dalej, że po raz pierwszy MCTS został zastosowany do generowania scen, gdzie jest on ujęty w ramy sekwencyjnego procesu decyzyjnego, umożliwiając tworzenie złożonych scen poza początkowym zestawem szkoleniowym.

Inną godną uwagi cechą jest podejście do uczenia się modelu. Wykorzystuje on uczenie ze wzmocnieniem, w którym otrzymuje "nagrodę" za wymyślanie scen, które odnoszą się do określonych przykazań. Z czasem model uczy się tworzyć środowiska bardzo przypominające pożądane rezultaty. Użytkownicy mogą kierować systemem za pomocą specjalnie dostosowanych podpowiedzi wizualnych, takich jak "stwórz kuchnię z czterema jabłkami i miską umieszczoną na stole". Wyniki są imponujące, ponieważ model ten przewyższa swoich konkurentów w zadaniach o co najmniej 10%. Ale to nie wszystko - model może również modyfikować istniejące sceny na polecenie. Może tasować obiekty lub dodawać nowe, zachowując przy tym integralność środowiska. To tak, jakby mieć osobistego wirtualnego kierownika planu, który rozumie estetykę i fizykę.

Prawdziwym atutem tego systemu jest możliwość generowania bezcennych danych szkoleniowych dla robotyków. Wirtualne środowiska stają się kursem szkoleniowym, w którym roboty uczą się zadań takich jak układanie sztućców lub przydzielanie jedzenia na talerzach. Realistyczne symulacje tworzą idealną piaskownicę do szkolenia robotów do rzeczywistych zadań. Przyszłe iteracje tego systemu mają na celu włączenie interaktywnych elementów, takich jak szafki lub słoiki, które mogą być odzyskiwane przez roboty, dodając kolejną warstwę realizmu. Nicholas Pfaff komentuje również fakt, że sceny przedtreningowe mogą odbiegać od rzeczywistych. "Korzystając z naszych metod sterowania, możemy wyjść poza tę szeroką dystrybucję i próbkować z "lepszej"".

Patrząc dalej, zespół aspiruje do włączenia rzeczywistych obrazów do danych treningowych, wykorzystując technikę znaną jako Skalowalny Real2Sim. Pozwoliłoby to systemowi na konstruowanie środowisk bliższych tym, które roboty napotkają w rzeczywistości. Eksperci branżowi są dość optymistycznie nastawieni do tego rozwoju. Jeremy Binagia, naukowiec ds. zastosowań w Amazon Robotics, stwierdził, że sterowane generowanie scen zapewnia fizyczną wykonalność i pełne tłumaczenie 3D, a tym samym tworzenie znacznie bardziej wciągających scen. Badania te zostały wsparte przez Amazon i Toyota Research Institute i udostępnione na konferencji poświęconej uczeniu się robotów. Więcej szczegółów można znaleźć w artykule artykuł oryginalny na MIT News.