Uczenie sztucznej inteligencji rozpoznawania zwierzaka: nowa metoda MIT uczy modele rozpoznawania spersonalizowanych obiektów

Zastanów się przez chwilę: Twój uroczy buldog francuski, Bowser, jest w lokalnym parku dla psów. Pośród plątaniny psich zabaw, twoje oczy z łatwością rozróżniają Bowsera. Ale co, jeśli chciałbyś, aby sztuczna inteligencja robiła to samo, gdy jesteś uwięziony w biurze? W tym momencie sprawy stają się skomplikowane.

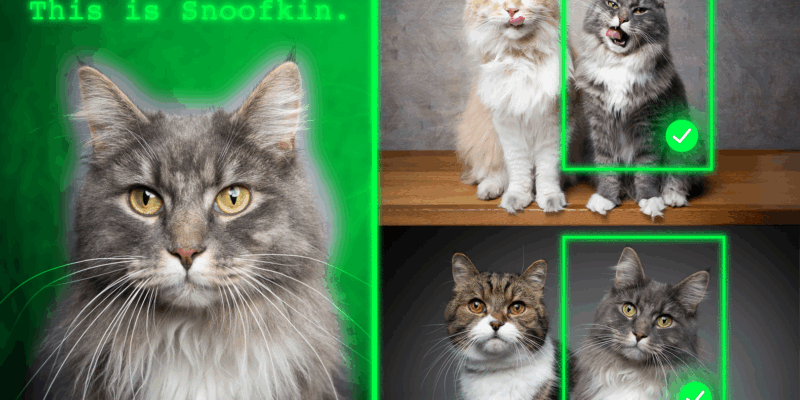

Nasze obecne modele wizyjno-językowe (VLM), takie jak popularny GPT-5, są doskonałe w wyodrębnianiu ogólnych obiektów. Na przykład zidentyfikowanie "psa" lub "drzewa" to pestka. Wyzwanie pojawia się jednak, gdy modele te mają za zadanie wskazać konkretny, spersonalizowany obiekt. Jeśli oczekujesz, że sztuczna inteligencja rozpozna Bowsera Frenchie w szeregu buldogów francuskich, prawdopodobnie się pogubi. Stanowi to przeszkodę dla każdego, kto zamierza wykorzystać sztuczną inteligencję do zadań takich jak monitorowanie zwierząt domowych, śledzenie obiektów lub technologia wspomagająca.

Dążenie do personalizacji

Aby wypełnić tę lukę, naukowcy z MIT i MIT-IBM Watson AI Lab opracowali nową metodę szkolenia, która umożliwia modelom sztucznej inteligencji skuteczniejsze rozpoznawanie spersonalizowanych obiektów w różnych scenach. Pracowali nad ponownym trenowaniem VLM przy użyciu specjalnie wyselekcjonowanych danych śledzenia wideo, które śledzą ten sam obiekt w serii klatek. Metoda ta zasadniczo zmusza model do polegania na wskazówkach kontekstowych, a nie na zapamiętanych informacjach. Model AI jest zasilany garścią przykładowych obrazów konkretnego obiektu, na przykład zwierzęcia domowego lub plecaka. Zmodernizowany system staje się znacznie lepszy w identyfikowaniu tego obiektu na nowych obrazach, zachowując jednocześnie szersze możliwości modelu.

Ożywianie

Postęp ten może być przełomem w różnych dziedzinach. Od systemów sztucznej inteligencji śledzących określone zwierzęta do badań środowiskowych po technologie wspomagające niedowidzących użytkowników w lokalizowaniu rzeczy osobistych w ich domach, możliwości są liczne. Technika ta może również wzmocnić robotykę i narzędzia rzeczywistości rozszerzonej wymagające szybkiej i dokładnej identyfikacji określonych obiektów w zmieniającym się otoczeniu.

Projektem kieruje Jehanzeb Mirza, postdoc z MIT i starszy autor artykułu badawczego. Oprócz Mirzy, kluczową rolę w projekcie odegrał również zespół naukowców z MIT, Weizmann Institute of Science i IBM. Ich odkrycia zostaną zaprezentowane na nadchodzącej Międzynarodowej Konferencji Wizji Komputerowej.

Naśladowanie ludzkiego umysłu

Według Mirzy, ostatecznym celem tych modeli jest "uczenie się z kontekstu, tak jak robią to ludzie". Jeśli model sztucznej inteligencji może to osiągnąć, to zamiast przekwalifikowywać go do każdego nowego zadania, model mógłby zostać zasilony kilkoma przykładami i wywnioskowałby, jak wykonać zadanie z tego kontekstu. Jego zdaniem byłaby to bezkonkurencyjna umiejętność. Wizja ta nie jest jednak pozbawiona własnego zestawu wyzwań. Społeczność badawcza nie znalazła jeszcze ostatecznej odpowiedzi na pytanie, dlaczego VLM zmagają się z problemami, z którymi nie radzą sobie ludzie. Problem może leżeć w integracji komponentów wizualnych i językowych, gdzie niektóre informacje wizualne mogą zostać utracone, ale wniosek nie jest jeszcze jednoznaczny.

Praca zespołu zaowocowała imponującymi postępami. Dzięki nowo wyselekcjonowanemu zbiorowi danych zaobserwowano średnią poprawę o 12% w spersonalizowanej lokalizacji obiektów. Co więcej, gdy zamiast rzeczywistych nazw obiektów użyto pseudonimów, wydajność wzrosła nawet o 21%. Dodatkowo, im większy model, tym większe korzyści. W miarę postępów zespół planuje zagłębić się w niespójności uczenia się VLM i LLM oraz zbadać nowe strategie w celu zwiększenia wydajności VLM bez konieczności ciągłego ponownego szkolenia modeli.

Zdając sobie sprawę z ogromnego potencjału szybkiego, specyficznego dla instancji ugruntowania w praktycznych przepływach pracy, Mirza i jego zespół wierzą, że ich podejście skoncentrowane na danych może pomóc w powszechnej integracji modeli opartych na języku wizyjnym. Do Mirzy w tej przełomowej pracy dołączyli Wei Lin, Eli Schwartz, Hilde Kuehne, Raja Giryes, Rogerio Feris, Leonid Karlinsky, Assaf Arbelle i Shimon Ullman, a finansowanie pochodziło z MIT-IBM Watson AI Lab.

Więcej szczegółów można znaleźć w oryginalnym artykule tutaj.