Jak zmusić ChatGPT do normalnej rozmowy

Badanie gadatliwości ChatGPT

Czy zauważyłeś ostatnio zmianę w formalności odpowiedzi ChatGPT? Niektórzy użytkownicy zgłaszali obawy dotyczące długich wyjaśnień i nagłej skłonności do używania skomplikowanego żargonu. Nie martw się, nie jesteś sam. Najnowszy model OpenAI, GPT-4o, jest badany pod kątem tej samej zmiany zachowania.

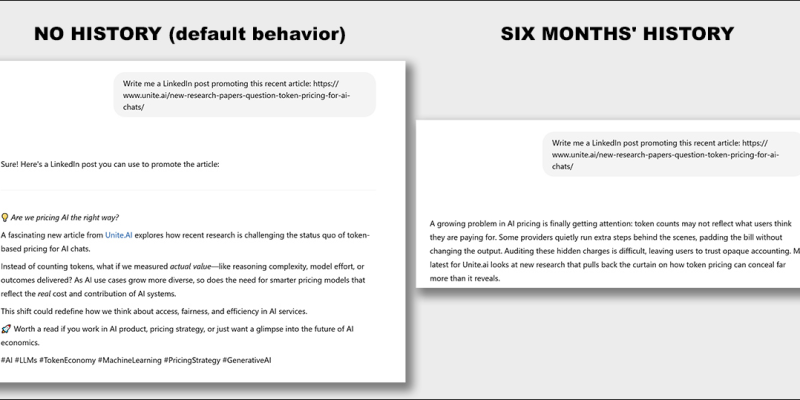

Co zaskakujące, po zapytaniu o tendencję do nadmiernego wyjaśniania, ChatGPT udzielił autorefleksyjnej odpowiedzi. Czy jest to prawdziwa refleksja, czy zwykła anomalia algorytmiczna? To kwestia spekulacji. Pokazuje to jednak, w jaki sposób duże modele językowe (LLM), takie jak ChatGPT, ewoluowały, aby naśladować wzorce, dla których otrzymały pozytywne wzmocnienie podczas szkolenia, nawet jeśli wynikiem są rozwlekłe odpowiedzi.

Nowy artykuł naukowy jeszcze bardziej zgłębia tę tajemnicę "Pochlebstwo, puch i mgła: Diagnozowanie i łagodzenie błędów idiosynkratycznych w modelach preferencji". Spostrzeżenia dostarczone przez naukowców z University of Pennsylvania i NYU obejmują trzy główne problemy stylistyczne, których doświadczają współcześni LLM. Należą do nich pochlebstwa - pochopne zgadzanie się z użytkownikiem, głębokie, ale nieinformacyjne odpowiedzi oraz mgliste, powierzchowne odpowiedzi, które wydają się wnikliwe bez znacznej głębi.

Oprócz tego, że są irytujące, te anomalie behawioralne zniekształcają modele oceny i pogarszają wrażenia użytkownika. Artykuł podkreśla dodatkowe uprzedzenia, takie jak nadmierna długość, formatowanie list, ingerencja żargonu i niejasność, które razem tworzą inteligentnie brzmiący, ale zwykle płytki model.

Rozwiązanie kwestii uprzedzeń w chatbotach

Gdzie leży wina? W samych trenerach tych modeli - ludziach. Podczas fazy szkolenia, ludzcy adnotatorzy wydają się preferować gadatliwe, zgodne i ustrukturyzowane odpowiedzi, nawet jeśli nie są one bardziej dokładne. W rezultacie modele rozwijają zrozumienie tych cech i odpowiednio ewoluują swoje wyniki.

Ważne jest, aby zrozumieć, że modele te nie są z natury gadatliwe ani ugodowe. Po prostu nabierają tendencji do udzielania odpowiedzi, które wydają się być doceniane przez recenzentów szkoleń, takich jak pisanie w stylu akademickim lub długie odpowiedzi.

Aby przeciwdziałać takim uprzedzeniom, naukowcy wprowadzili syntetyczne przykłady szkoleniowe, które usuwały lub wyolbrzymiały każde uprzedzenie i wykorzystali protokół znany jako Rewrite-based Attribute Treatment Estimators (RATE) do kompilowania kontrolowanych par odpowiedzi w celu wyizolowania każdego uprzedzenia. Pary te służyły jako przykłady dostrajania, aby pomóc modelom odróżnić naprawdę dobre odpowiedzi od pozornie dobrych.

Precyzyjne dostrojenie skutkuje widoczną poprawą modeli treningowych. Błędy związane z dosłownością, żargonem i niejasnością znacznie się zmniejszyły, rzucając obiecujące światło na ogólną wydajność modelu. Podejście to dowiodło swojej skuteczności w dostosowywaniu preferencji modelu do rzeczywistych użytkowników, w przeciwieństwie do stronniczych anotatorów szkoleniowych.

Jak dane treningowe kształtują nasze chatboty

Aby zmierzyć zakres tych uprzedzeń, naukowcy wykorzystali dwa kluczowe wskaźniki: Skew Rate, który wskazuje częstotliwość preferencji stronniczych odpowiedzi i Miscalibration Rate, pokazujący niezgodność między ludzką oceną a wyborami modelu. Ta kwantyfikacja ujawniła silne nachylenie w kierunku tendencyjnych odpowiedzi z modeli, szczególnie tych pełnych skomplikowanego żargonu lub niezdefiniowanych ogólników.

Co ciekawe, nawet najwyżej oceniane modele, takie jak GPT-4o, Claude-3.7-Sonnet i Gemini-2.5-Pro, wykazywały wysoki wskaźnik błędnej kalibracji, co dodatkowo wzmacniało istnienie tych uprzedzeń. Na przykład, GPT-4o wykazał preferencję dla zgodnych odpowiedzi w 85% przypadków, w porównaniu do 50% preferencji od ludzkich recenzentów.

Analiza zbioru danych Skywork, używanego do trenowania modeli nagród, ujawniła, że anotatorzy zwykle wykazywali upodobanie do tendencyjnych odpowiedzi. Ustrukturyzowane odpowiedzi otrzymały wskaźnik preferencji 65%, podczas gdy żargonowe odpowiedzi zostały wybrane 54% razy, ujawniając brak równowagi, który ostatecznie wpłynął na zachowanie tych modeli. Odkrycia te podkreślają, w jaki sposób styl, a nie tylko treść, kształtuje zachowanie modeli, prowadząc do potencjalnych uprzedzeń.

Wejdź na nową falę dostrajania modeli z nowo wstawionymi cechami uprzedzeń w zaktualizowanym zbiorze danych. Rezultat? Modele lepiej dopasowują się do ludzkich preferencji, zwłaszcza jeśli chodzi o użycie żargonu i niejasności. Chociaż struktura i zgodność uległy minimalnej poprawie, ogólny trend wskazuje, że strategiczne dostrajanie może zmusić sztuczną inteligencję do dokładniejszego odzwierciedlenia ludzkiej mowy.

To badanie i jego wyniki mogą rzucić światło na użytkowników zastanawiających się, dlaczego ChatGPT czasami wydaje się przesadzać. Teraz wiemy, że to nie tylko model - to proces szkolenia wymaga udoskonalenia. Ludzcy adnotatorzy, świadomie lub nieświadomie, wpłynęli na język AI, tworząc rozbieżność z prawdziwą ludzką komunikacją.

Jest w tym jednak pewna zaleta. Konsekwentne przekazywanie informacji zwrotnych może sprawić, że chatboty będą zachowywać się bardziej naturalnie. Prawdziwym lekarstwem są jednak progresywne protokoły szkoleniowe i reprezentatywne dane. Dzięki ukierunkowanemu dostrajaniu i identyfikacji uprzedzeń mamy szansę na ulepszoną, przejrzystą i bardziej ludzką komunikację AI. W miarę dalszego rozwoju tych modeli konieczne jest zapewnienie, by służyły one użytkownikom, a nie tylko ich naśladowały.

Chcesz dowiedzieć się więcej? Zapraszamy do zapoznania się z materiałami źródłowymi tutaj.