Tkanie rzeczywistości czy jej wypaczanie? Pułapka personalizacji AI

Świat stworzony przez sztuczną inteligencję: gdzie rzeczywistość się rozpada?

Rozejrzyj się dookoła, a wszystko stanie się jasne: sztuczna inteligencja nie jest w drodze - ona już tu jest, kształtując sposób, w jaki postrzegamy i rozumiemy świat. Za każdym razem, gdy otwierasz aplikację lub szukasz wiadomości, algorytmy po cichu dostosowują to, co widzisz, organizując samą rzeczywistość w kolaż, który pasuje do twoich upodobań, niechęci i zachowań online.

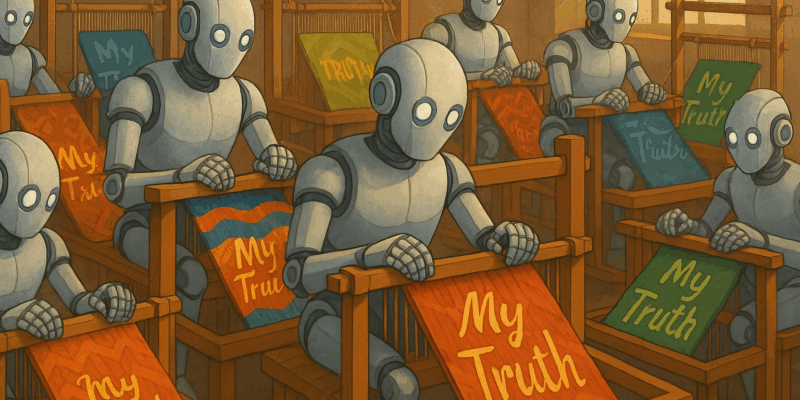

Wiąże się z tym jednak niewygodna prawda. Im bardziej nasze cyfrowe doświadczenia są dostosowane do naszych indywidualnych upodobań, tym bardziej poszarpane staje się nasze poczucie prawdy. Coraz częściej to, co każdy z nas przyjmuje jako “prawdziwą historię”, może wyglądać zupełnie obco w stosunku do kanału innej osoby. Żyjemy nie w jednej wspólnej rzeczywistości, ale w niezliczonych “syntetycznych rzeczywistościach”, z których każda jest dostosowana do naszego osobistego echa.

Efekt komory echa: Kiedy personalizacja idzie za daleko

Z pozoru prawie wszystko w tej hiperpersonalizacji wydaje się być ulepszeniem. Kanały wyselekcjonowane przez sztuczną inteligencję dostarczają nam wiadomości, rekomendacje i rozrywkę dostosowaną do wydajności i trafności. Dostajemy dokładnie to, czego chcemy, dokładnie wtedy, kiedy tego chcemy. Ale oto ukryty koszt: poprzez ciągłe dostarczanie nam treści, które pasują do naszego istniejącego światopoglądu, systemy te mogą odgrodzić nas od nowych pomysłów i niewygodnych faktów.

Rzeczywistość, którą widzimy w Internecie, może wydawać się obiektywną prawdą, ale istnieje duże prawdopodobieństwo, że jest to tylko jedna starannie przefiltrowana wersja. Im częściej spotykamy się tylko z wiadomościami i poglądami, które pasują do naszych z góry przyjętych wyobrażeń, tym łatwiej jest rozdzielić grupy, rozmowy utknąć w martwym punkcie, a debaty publiczne stają się polem bitwy, a nie miejscem spotkań. Nie chodzi tylko o różne opinie - chodzi o całe rzeczywistości, które po cichu coraz bardziej się od siebie oddalają.

Istnieje również subtelniejsze ryzyko: historie, którym ufamy najbardziej, te, które wydają się idealnie pasować do tego, w co już wierzymy, mogą nawet nie być całą historią. Systemy sztucznej inteligencji są tak biegłe w dostosowywaniu treści, że mogą delikatnie szturchać nasze przekonania, pogłębiać podziały i podważać zaufanie - nie tylko do wiadomości, ale także do naszych instytucji i do siebie nawzajem.

Budowanie mostów w spersonalizowanej erze

Droga naprzód wymaga czegoś więcej niż tylko zaakceptowania tych fragmentarycznych realiów. Deweloperzy, organy regulacyjne i my wszyscy jako użytkownicy mamy udział w kształtowaniu systemów sztucznej inteligencji, które są zarówno przejrzyste, jak i sprawiedliwe. Oznacza to naciskanie na jaśniejsze wyjaśnienia działania algorytmów, celowe poszukiwanie różnych źródeł i doskonalenie naszych umiejętności cyfrowych, aby dostrzec, kiedy jesteśmy popychani dalej do naszych stref komfortu.

Tylko z otwartymi oczami i wspólnym wysiłkiem możemy zacząć naprawiać rozdźwięki i pracować nad wspólnym poczuciem tego, co prawdziwe - cyfrowego krajobrazu, w którym personalizacja pomaga, ale nie dzieli.

Chcesz zagłębić się w tę rozmowę? Przeczytaj cały artykuł na VentureBeat: Tkanie rzeczywistości czy jej wypaczanie? Pułapka personalizacji w systemach sztucznej inteligencji.