MIT-Forscher entwickeln AI-System, das Objekte aus Sprache baut

Worte in greifbare Realität verwandeln: Eine neue Ära der unmittelbaren Schöpfung

Stellen Sie sich eine Realität vor, in der Sie einen Wunsch nach einem Stuhl äußern und dieser innerhalb von Minuten vor Ihren Augen zum Leben erweckt wird. Dank innovativer Durchbrüche von MIT-Forschern ist ein solches Szenario nicht mehr nur Stoff für Science-Fiction. Entwickelt wurde ein KI-gesteuerter Mechanismus mit dem Namen “Speech-to-Reality”, der es den Nutzern ermöglicht, ihre Konzepte buchstäblich in die Welt zu sprechen. Durch die Integration von Robotik und generativer KI ist das System in der Lage, gesprochene Hinweise in physisch greifbare, zusammengesetzte Objekte umzuwandeln.

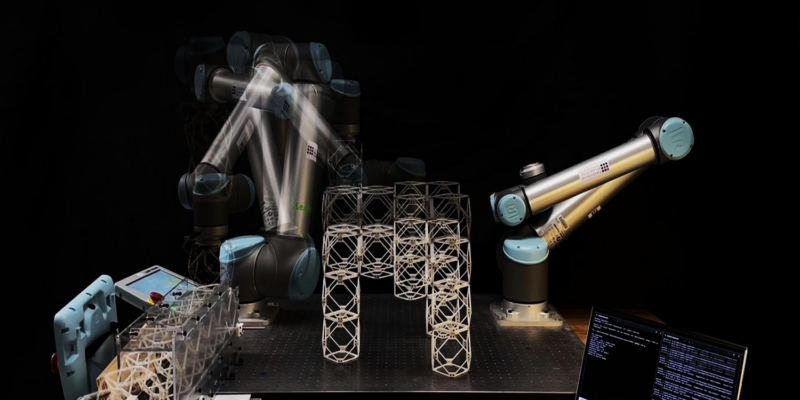

Das Herzstück dieser fortschrittlichen Innovation ist ein Roboterarm, der auf einem Arbeitstisch positioniert ist. Der Benutzer muss nur einen einfachen Wunsch äußern, etwa in der Art von “Ich möchte einen einfachen Hocker”, und den Rest erledigt das System. Der Prozess beginnt mit einer Spracherkennungssoftware, die den Wunsch mit Hilfe eines umfassenden Sprachmodells entschlüsselt. Daraufhin konstruiert eine generative 3D-KI ein digitales Netz des gewünschten Objekts. Anschließend wird dieses Netz in ein voxel-zentriertes Design übersetzt, das wiederum in modulare Teile zerlegt wird, die der Roboter zusammenbauen kann.

Die Kombination von KI, Sprachkenntnissen und robotergestützter Präzision

Bevor die eigentliche Konstruktion beginnt, prüfen geometrische Algorithmen den Entwurf auf seine praktische Durchführbarkeit, indem sie die Stabilität bewerten, Überhänge reduzieren und Teilverbindungen planen. Alexander Htet Kyaw, ein MIT-Postgraduiertenstudent und Stipendiat an der Morningside Academy for Design, beschreibt den Prozess als eine erstmalige Verschmelzung von natürlicher Sprachverarbeitung, generativer 3D-KI und robotischer Montage. Der letzte Schritt ist ein robotergesteuerter Pfadplan, der das Objekt zeitnah zusammensetzt.

Das System wurde im Rahmen des Kurses “How to Make Almost Anything” unter der Leitung von Professor Neil Gershenfeld entwickelt. Alexander hat das System im Center for Bits and Atoms (CBA) des MIT in Zusammenarbeit mit seinen Kommilitonen Se Hwan Jeon aus dem Maschinenbau und Miana Smith aus dem CBA weiter verfeinert. Mit diesem System hat das Team eine Reihe von Gegenständen hergestellt, von Hockern, Regalen und kleinen Tischen bis hin zu Stühlen und sogar Ziergegenständen wie einer Hundestatue. Durch den schnellen Zusammenbau und die reibungslose Demontage erweist sich das System als schnell und nachhaltig zugleich.

Visionen für eine sprachgesteuerte Zukunft

Das System erweist sich als überlegen gegenüber dem herkömmlichen 3D-Druck, der ein langsamer Prozess sein kann, der sich oft über Stunden oder sogar Tage erstreckt. Und was noch wichtiger ist: Es beseitigt das Hindernis, dass man über Kenntnisse in 3D-Modellierung oder Roboterprogrammierung verfügen muss. Dieser neue Ansatz bedeutet, dass jeder, der sprechen kann, Zugang zum Design- und Herstellungsprozess hat. Mit Blick auf die Nachhaltigkeit hat das Team dafür gesorgt, dass die modularen Teile wiederverwendbar sind, so dass die Objekte zerlegt und in neuen Formen wieder aufgebaut werden können.

Derzeit bemüht sich das Team darum, die strukturelle Haltbarkeit der entstehenden Produkte zu verbessern, indem magnetische Verbindungspunkte durch robustere Verbindungstechniken ersetzt werden. Außerdem wird überlegt, wie das System für verteilte mobile Roboter skaliert werden kann, so dass der Bau ausgedehnter Strukturen möglich wird. Inspiriert von den Replikatoren aus “Star Trek” und den Konstruktionsrobotern aus “Big Hero 6” stellt sich Alexander eine Zukunft vor, in der die Erstellung physischer Objekte so einfach ist wie das Aussprechen einer Anfrage. Außerdem versucht er, Gestenerkennung und Augmented-Reality-Schnittstellen in das System einzubinden, um eine instinktivere Interaktion zwischen Mensch und Roboter zu ermöglichen.

Ihre Forschung wurde in einem Vortrag mit dem Titel “Speech to Reality: On-Demand Production using Natural Language, 3D Generative AI, and Discrete Robotic Assembly” auf dem ACM Symposium on Computational Fabrication vorgestellt, das am 21. November am MIT stattfand. Einen tieferen Einblick in die Studie können Sie auf der Website Originalartikel auf MIT News.