Naukowcy z MIT opracowują system sztucznej inteligencji, który buduje obiekty na podstawie mowy

Przekształcanie słów w namacalną rzeczywistość: nowy początek natychmiastowego tworzenia

Wyobraź sobie rzeczywistość, w której wystarczy wypowiedzieć prośbę o krzesło, a ono pojawia się na twoich oczach w ciągu kilku minut. Dzięki przełomowym odkryciom naukowców z MIT taki scenariusz nie jest już tylko fantazją science fiction. Opracowano mechanizm sterowany przez sztuczną inteligencję, nazwany “speech-to-reality” (od słowa do rzeczywistości), który umożliwia użytkownikom dosłowne urzeczywistnianie swoich pomysłów za pomocą głosu. Dzięki połączeniu robotyki z generatywną sztuczną inteligencją system jest w stanie przekształcić wypowiedziane polecenia w fizycznie namacalne, zmontowane obiekty.

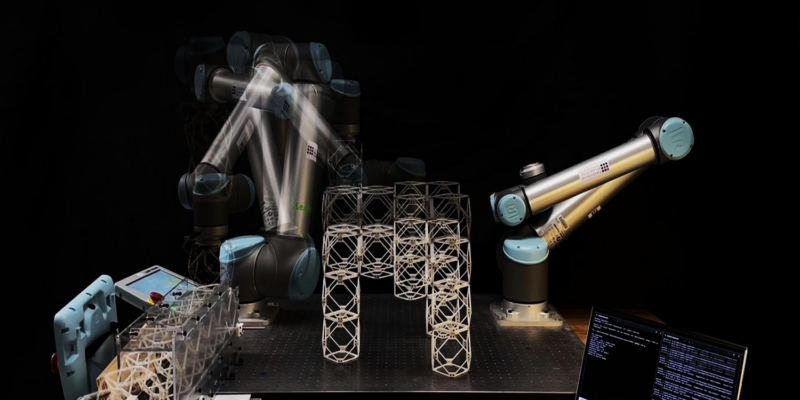

Sercem tej przełomowej innowacji jest ramię robota umieszczone na stole roboczym. Użytkownik musi jedynie wypowiedzieć proste życzenie, na przykład “Chcę prosty stołek”, a resztą zajmie się system. Proces rozpoczyna się od rozszyfrowania żądania przez oprogramowanie do rozpoznawania mowy przy pomocy kompleksowego modelu językowego. Następnie generatywna sztuczna inteligencja 3D tworzy cyfrową siatkę pożądanego obiektu. Siatka ta jest następnie przekształcana w projekt oparty na wokselach, który jest dalej dzielony na modułowe części, które robot może złożyć.

Połączenie mocy sztucznej inteligencji, biegłej znajomości języków i precyzji robotyki

Przed rozpoczęciem właściwej budowy algorytmy geometryczne analizują projekt pod kątem praktycznej wykonalności, oceniając stabilność, redukując nawisy i planując połączenia części. Alexander Htet Kyaw, doktorant MIT i stypendysta Morningside Academy for Design, opisuje ten proces jako pierwsze w swoim rodzaju połączenie przetwarzania języka naturalnego, generatywnej sztucznej inteligencji 3D i montażu zrobotyzowanego. Ostatnim krokiem jest zautomatyzowany plan trasy, który umożliwia szybki montaż obiektu.

Pomysł na system powstał podczas kursu “Jak zrobić prawie wszystko” prowadzonego przez profesora Neila Gershenfelda. Alexander dopracował system w Centrum Bitów i Atomów (CBA) MIT, współpracując z innymi studentami studiów magisterskich, Se Hwan Jeonem z wydziału inżynierii mechanicznej i Mianą Smith z CBA. Dzięki temu systemowi zespół wyprodukował szereg przedmiotów, od stołków, półek i małych stolików po krzesła, a nawet elementy dekoracyjne, takie jak figurka psa. Dzięki szybkiemu montażowi i łatwemu demontażowi system ten okazał się zarówno szybki, jak i zrównoważony.

Wizja przyszłości opartej na tworzeniu sterowanym głosem

System ten okazuje się lepszy od konwencjonalnego drukowania 3D, które może być powolnym procesem, często trwającym wiele godzin, a nawet dni. Co ważniejsze, eliminuje on konieczność posiadania umiejętności w zakresie modelowania 3D lub programowania robotów. To nowe podejście oznacza, że każdy, kto potrafi mówić, ma dostęp do procesu projektowania i produkcji. Koncentrując się na zrównoważonym rozwoju, zespół zadbał o to, aby modułowe części były łatwe do ponownego wykorzystania, umożliwiając demontaż obiektów i przebudowę ich w nowe formy.

Obecnie zespół pracuje nad poprawą wytrzymałości strukturalnej powstałych produktów poprzez zastąpienie magnetycznych punktów połączeń bardziej wytrzymałymi technikami łączenia. Zastanawia się również nad skalowaniem systemu dla rozproszonych robotów mobilnych, co potencjalnie umożliwi budowę rozległych konstrukcji. Zainspirowany replikatorami z serialu “Star Trek” i robotami budowlanymi z filmu “Wielka szóstka”, Alexander wyobraża sobie przyszłość, w której tworzenie obiektów fizycznych będzie tak proste, jak wypowiedzenie prośby. Ponadto stara się wbudować w system rozpoznawanie gestów i interfejsy rzeczywistości rozszerzonej, aby zapewnić bardziej instynktowną interakcję między ludźmi a robotami.

Wyniki ich badań zostały przedstawione w artykule zatytułowanym “Speech to Reality: On-Demand Production using Natural Language, 3D Generative AI, and Discrete Robotic Assembly” (Od słów do rzeczywistości: produkcja na żądanie z wykorzystaniem języka naturalnego, generatywnej sztucznej inteligencji 3D i dyskretnego montażu robotycznego) podczas sympozjum ACM Symposium on Computational Fabrication, które odbyło się 21 listopada na MIT. Aby zapoznać się z szczegółami badania, można odwiedzić stronę oryginalny artykuł w MIT News.